きっかけ

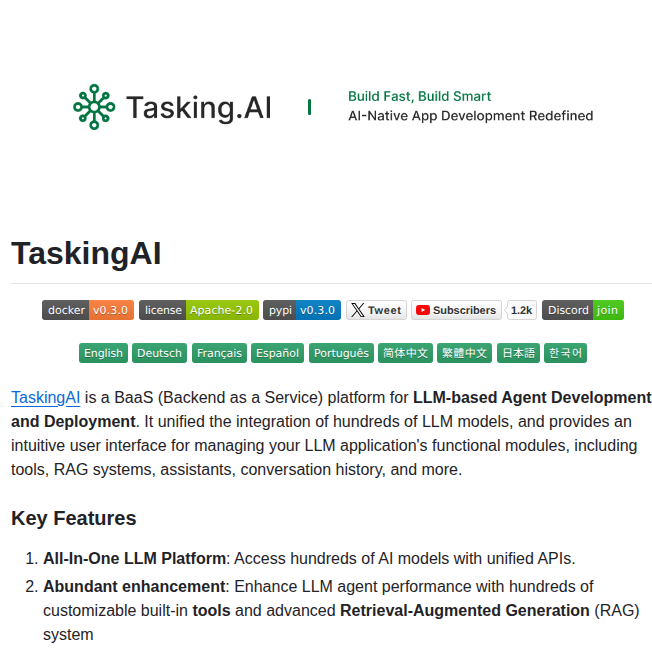

これまで自分たちのチームでAIを使ったアプリケーション開発をしていて、複数のLLMを組み合わせて使う場面が増えてきた。ただGPT-4、Claude、Geminiみたいなモデルをそれぞれ使い分けるたびに、APIキーの管理とプロンプト設定がかなり煩雑になっていた。Pythonで全部書き直すのも手だけど、プロンプトを調整するたびにコミットするのは流石に微妙だなと思ってた。そんなときにTaskingaiをGitHubで見かけて触ってみることにした。LLMの推論速度を高速化したい場合はvLLM高速推論の導入ガイドも参考にどうぞ。

使ってみた

セットアップ自体は本当にシンプルで、git cloneしてpip install taskingaiするだけで基本的な環境は整った。公式のサンプルを見ながら、さっさと自分たちのモデル接続を試してみた。驚いたのは、ダッシュボード経由でプロンプトを登録して、APIで呼び出すだけで使える流れ。つまり、プロンプトを変更するたびにコードの修正が不要になった。試しに既存のプロンプトをバージョン管理してみたら、ロールバックも簡単だし、チーム内でプロンプトの修正も共有しやすくなった。

ここが良い

一番気に入ったのは、プロンプト管理とモデル管理が一つのUIに統合されてる点。これまでは.envファイルにAPIキーを突っ込んで、プロンプトはPythonのコードに直書きしてたから、本番環境での変更がめちゃくちゃ面倒だった。Taskingaiだと、ダッシュボード上でプロンプトのテンプレート変数を設定したり、モデルのパラメータを調整したりできる。特に複数のモデルを順番に使うパイプラインを構築するときに、各ステップのプロンプトをビジュアルに管理できるのは本当に助かる。これまで同じ処理を3ステップで実装していたのが、1つのコンポーネントで実装できるようになった。

気になった点

ドキュメントがまだ完全じゃなくて、エッジケースに当たると情報が少ないのが難点。あと、スケーリングに関する具体的な運用ガイドがあると嬉しい。ただ、GitHub Discussionsは結構活発だから、詰まったら聞けば大体解決する。

まとめ

AIのプロンプトエンジニアリングをチーム全体で管理したい、複数のモデルを使い分けてるけど管理が大変という人には絶対試す価値がある。自分たちのチームはこれで確実に開発速度が上がった。今後もこの流れで運用していく予定。より高度なLLMパイプラインを構築したい場合はDistributed Llamaで複数PCにLLMを分散実行する方法も参考になります。