// なぜ使えるか

今までは長いPDFを一気にAIに投げて対応してもらってた。ページごとに分割して処理すると、内容取りこぼしがなくなって精度が上がった

きっかけ

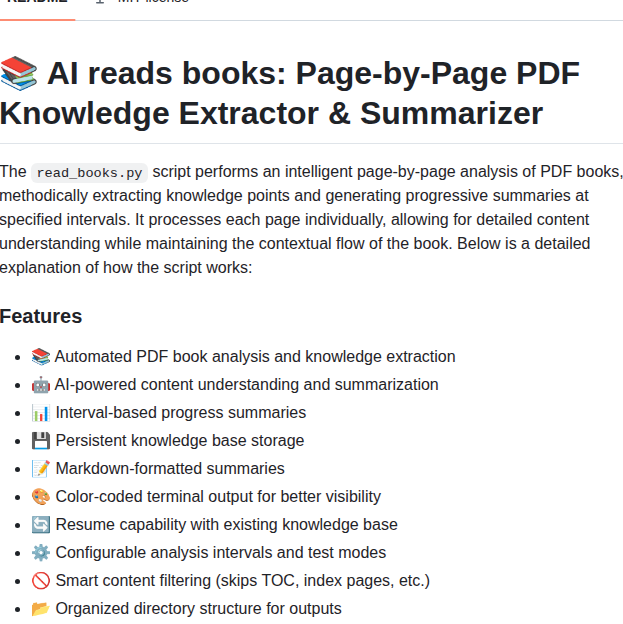

複数ページのPDFをAIに読ませて要約・分析する際、ページ数が多いと精度の低下やトークン消費の増加が課題になる。このリポジトリは、そうした問題に対するページごとの自動処理を実現するツール。

使ってみた

GitHubからクローンして、必要なライブラリをインストール。pip install -r requirements.txt で環境整えて、PDFファイルを指定して実行すると、ページごとに自動でスプリットして処理してくれる仕組み。手動でページを切り出す手間と複数のAPIコール管理の面倒くささが解消される。

ここが良い

ページの自動分割機能が優れている。従来は手作業でPDFを編集ソフトで切り出したり複数ページをまとめて投げたりする必要があった。ページごとに確実に処理される設計により、内容の抜け落ちを削減でき、信頼度の高い成果物を生成できる。

気になった点

ドキュメントが限定的であり、APIキー設定周りがやや分かりづらい。加えて、スクリプト内のMODELとANALYSIS_MODELをカスタマイズ可能な設計になっているものの、ローカルモデルとの組み合わせに関する具体的な説明が不十分。カスタマイズの実装にあたっては試行錯誤が必要になる可能性。

まとめ

複数ページのPDFを定期的に処理する業務に有用。財務資料、技術ドキュメント、研究論文、契約書といった長編PDFをAIに読ませたい場面は多い。このツールはそうした作業のシンプル化を実現する。

よくある質問

このツールは何をするものですか?

PDFファイルをページごとに自動で分割して、それぞれのページをAIに順番に読ませ、内容を処理・抽出するツール。長いPDF資料の内容を取りこぼさず確実に処理できます。

どうやってセットアップするんですか?

GitHubからリポジトリをクローンして、pip install -r requirements.txt でライブラリをインストール。APIキー設定して、PDFファイルを指定して実行するだけで動作します。

OpenAI以外のAIモデルも使えますか?

デフォルトではOpenAI APIに対応しており、ドキュメント上ではローカルモデルの組み合わせについて明記されていません。カスタマイズが必要な場合は試行錯誤が必要です。

処理時間はどのくらい短縮されるのでしょうか?

処理時間はPDFのページ数と内容量、使用するAIモデルの処理速度に依存します。ページごとに分割して処理することで、手動でのページ切り出しやAPIコール管理の手間が削減されます。

このツールを使うと精度は上がりますか?

ページごとに分割して処理することで、トークン制限に引っかかるリスクが減り、内容の取りこぼしが少なくなるため、結果として精度が向上する傾向があります。

Next Read →

🍎 Apple、iOS 26.4でオンデバイスLLMのコンテキストウィンドウ管理APIを追加

›